Znajdź zawartość

Wyświetlanie wyników dla tagów 'black hat' .

Znaleziono 100 wyników

-

Adres: smartindexer.net Kontakt: support@smartindexer.net Na start projektu promocja -30% do 26 września 2022 Kod rabatowy: mc30

- 78 odpowiedzi

-

- 1

-

-

- black hat

- pozycjonowanie

-

(i 7 więcej)

Oznaczone tagami:

-

Mam na stronie 20 000 tekstów wygenerowanych przez AI. W mapie strony są umieszczone mniej więcej w tym samym czasie. Zastanawiam się, czy je indeksować, i google je normalnie zaindeksuje traktując jak normalne teksty, czy konieczne jest stworzenie całości w taki sposób, żeby czas umieszczenia był inny.

- 48 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Cześć, znalazłem parę fajnych expirek, zarejestrowałem je i zrobiłem na każdej bloga - każda inne ip (cloudflare), inny motyw. Mam parę pytań odnośnie linkowania z nich do money site: 1. Ile odczekać czasu i dodać postów przed linkowaniem do money site? 2. Czy wcześniej pasuje żebym zamieścił linki do jakichś innych strony w artykułach ? 3. Jak linkować do money site? Targetować T1 czy raczej T2? Dodać 1 artykuł do money site czy co jakiś czas dodawać zmieniając tematy i anchory linków? 4. jakie rodzaje linkow zeby nie zabić money site ? (ma okolo 4 miesiące, świeża domena) 5. Jaki schemat linkowania ? jak mam załóżmy 5 pbnow to każdy między sobą niech linkuje i do moneysite czy google to wykryje? Przepraszam za taką ilość pytań ale pierwszy raz zakładam własne zaplecze i nie chciałbym żeby strona główna poszła do piachu przez moje głupie działania...

- 4 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Cześć chciałem pozakładać sieć pbnow, wyszukałem z 10 fajnych wygasłych domen, fajne linki, 0 spamu w archive.org, zarejestrowałem je, każda strona inny motyw, wrzuciłem po 4 artykuły. Problem jest taki że chyba mają bana? Nic nie chce się indeksować, cały czas wysyłam prośby ale poprostu nie chce. Dodatkowo żadnych ręcznych działań w gsc. Co zrobić? Możliwe że archive.org nie pokazywał akurat spamu jak był i mają bana? Jak je odbanować?

- 10 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

kupilem pare wygaslych domen z miare dobrymi linkami i na wielu z nich ujrzalem komunikat ze nalozono recznego bana? dodam ze sprawdzalem archive.org i zadnego syfu nie bylo a teraz dodalem jedynie artykuly z AI i raczej nie byl to spam 😕 (chyba ze mozna zobaczyc kiedy nalozono tego bana?) macie jakies porady? oczywiscie zlozylem odwolanie ale nie wiem czy nawet jak strona wyjdzie z bana to bede mogl linkowac do money site? oczywiscie domeny sa na roznych ip

- 2 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Witam, czy zna ktoś dobry indekser nadający się do indeksowania linków pochodzących z blastów ?

- 11 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

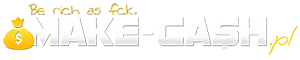

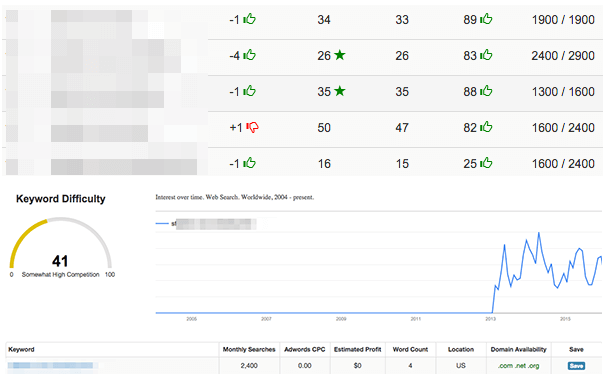

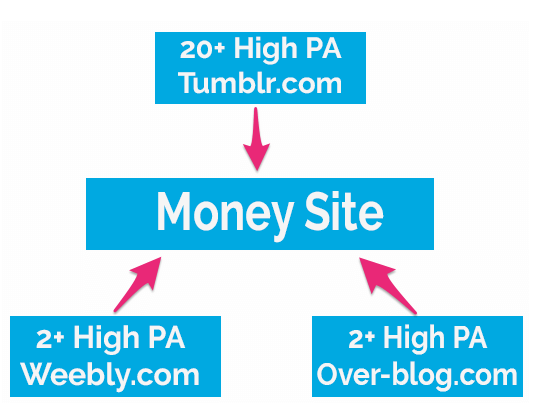

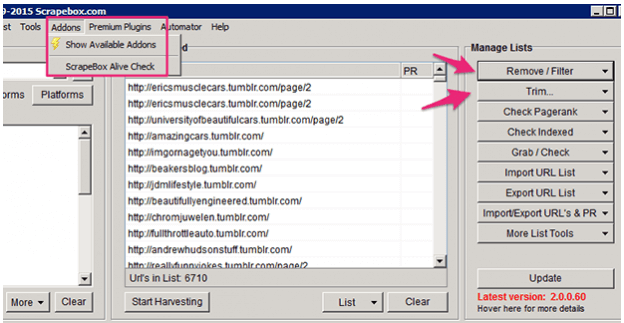

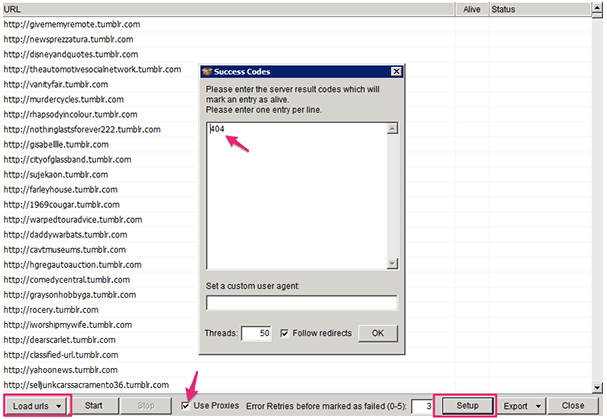

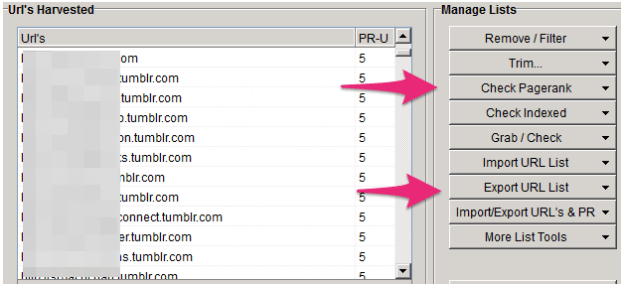

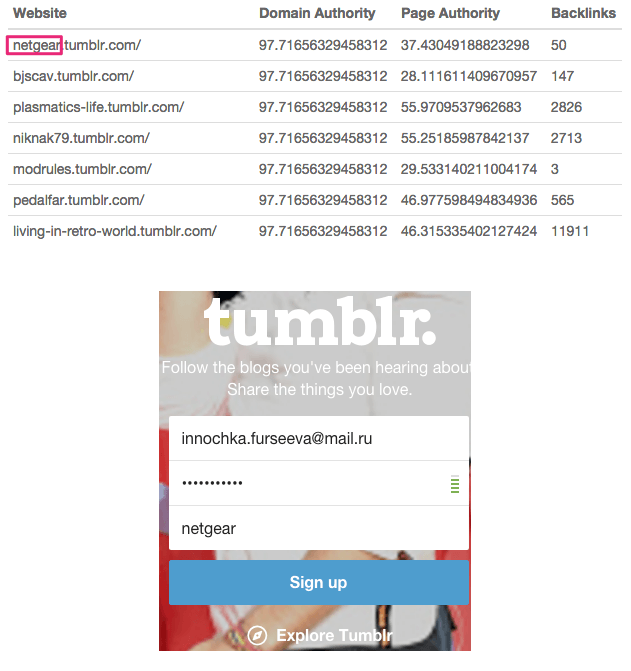

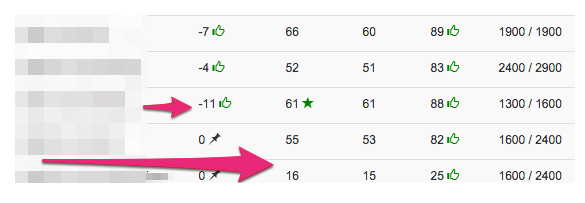

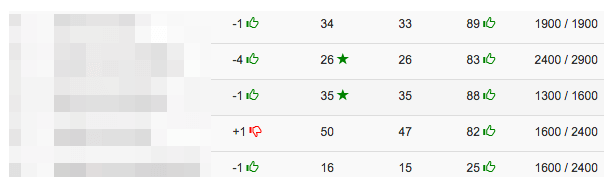

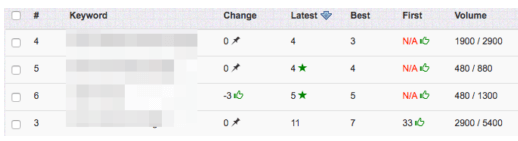

Poradnik Jak stworzyć prywatną sieć blogów Web 2.0 - PBN

Wujek Ziemny opublikował(a) temat w Linkowanie i linkbuilding

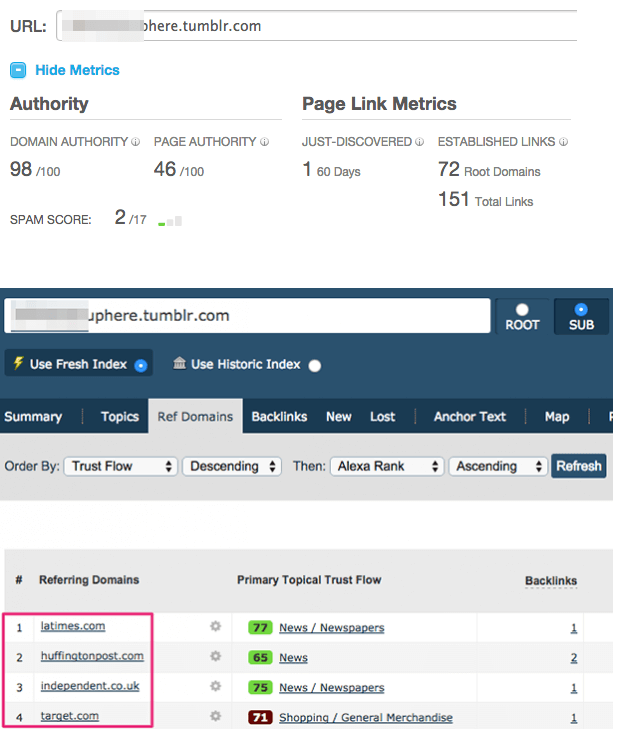

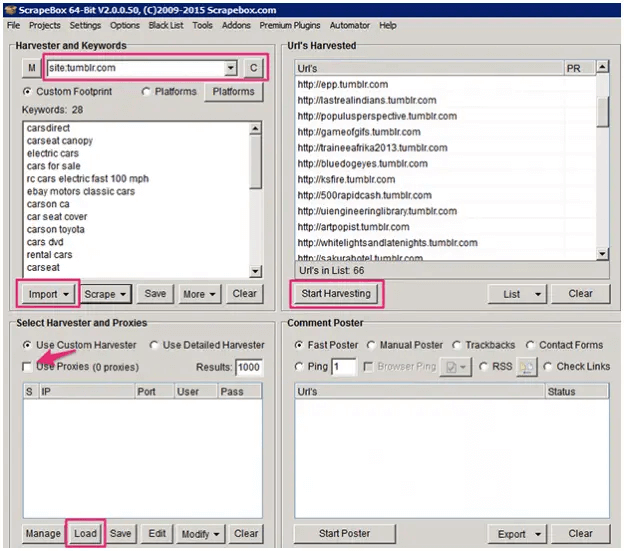

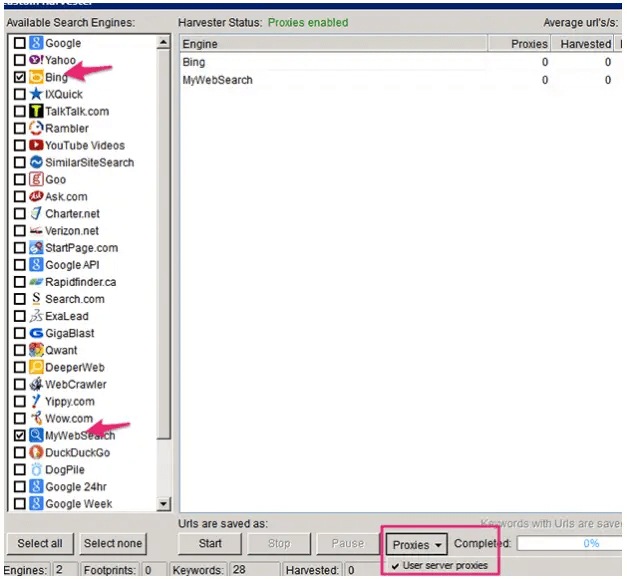

Wszystkim nam zdarzyło się znaleźć w sieci fajną, dużą stronę z dobrą treścią zajmującą topowe pozycje w wyszukiwarkach. Ale czy ktoś z Was zatrzymał się na chwilę, by pomyśleć skąd te witryny biorą swoją siłę przebicia? Unikalna treść i dobra promocja stanowią główną część czynników wybijających strony na pierwsze strony wyszukiwarek. Naturalne backlinki, obecność w social media. W końcu są to rzeczy, które Google lubi, prawda? Ale co z osobami, które chcą wybić stronę pod Amazon, Adsense lub jakąkolwiek inną małą stronę? Naturalne backlinki są często i gęsto trudne do zdobycia, a najczęściej po prostu ich nie zdobywamy. Czy chcielibyście, by było tak cały czas? Pewnie nie, bo zazwyczaj osoby zajmujące się tworzeniem stron pod mikronisze lub afiliację tworzą je w jednym celu - zarobkowym. Jest to jedna z metod, których używam, by zarobić - składa się ona z trzech kroków, czyli wyszukiwanie i analiza słów kluczowych, tworzenie strony i budowanie backlinków. Trzeci krok może okazać się najtrudniejszym - w końcu chcesz pojawić się na pierwszej stronie. Pozwól więc, że pokażę Ci prostą metodę zdobywania linków do Twoich mikronisz. Czego nauczysz się z tego poradnika: jak zbudować silną prywatną sieć blogów z użyciem darmowych web 2.0 jak ustawiać wygasłe Tumblr'y w kilka minut jak znajdywać wygasłe strony web 2.0 jak tworzyć dowolną ilość backlinków web 2.0 czemu ta metoda działa i przynosi efekty Przykładowe wyniki z prywatnej sieci blogów Web 2.0 Tworzenie sieci blogów nie było na początku tak proste, jak mogłoby się wydawać. Po wielu zarwanych nocach i niezliczonej ilości kofeiny, udało mi się uzyskać świetnie wyniki używając jedynie blogów web 2.0 do utworzenia PBNa. Wszystko sprowadzało się do testowania i dostosowywania metody, póki nie znalazłem złotego środka. Jeden ze znajomych pozycjonerów pomagał mi również doradzając w niektórych miejscach. Oto istniejąca od dwóch tygodni strona użyta do testów. Konkurencja na tej mikroniszy jest stosunkowo duża, więc uważam te wyniki za jak najbardziej satysfakcjonujące. A tutaj nieco bardziej stabilne pozycje z innej strony, na której pracuję obecnie: A co jeśli chodzi o częściej wyszukiwane słowa kluczowe? Oto jeden ze starszych keywordów, których już nie monitoruje. Stoi on aktualnie na 3-cim miejscu w wynikach wyszukiwania. Screenshot pochodzi z zeszłego roku, a pozycja została uzyskana za pomocą jedynie wgasłych blogów web 2.0. O co chodzi? Mowa o budowaniu sieci wygasłych web 2.0 z wysokim authority linkującej prosto do twojej strony. Kupuję lub harvestuję wygasłe strony, jak ta na zdjęciu, a potem kieruję je na swoją stronę WWW. Brzmi dobrze, prawda? Silne web 2.0 gotowe do użycia. Ma to kilka plusów: strony te mają już swoje naturalne backlinki mają już pewien wiek mają wysokie authority, zazwyczaj 30+ są gotowe do przekazania mocy Twojej stronie Jeśli miałbym zbudować teraz świeżą sieć blogów, zajęłoby to trochę czasu zanim nabrałaby mocy. Musiałbym użyć narzędzia takiego jak np. GSA Search Engine Ranker, by je podlinkować. Czasem możesz uzyskać pierwsze wyniki w ciągu 24 godzin. Jest to natychmiastowa moc dla Twojej witryny! Nie jest tak duża jak w przypadku web 2.0 budowanych na własnym hostingu i domenach, ale masz tu pełną kontrolę nad swoimi linkami, a nie kosztuje Cię to ani grosza! GSA Search Engine Ranker i wiele innych programów znajdziecie w bardzo okazyjnej cenie w naszym forumowym SeoTools! Jak zbudować Twoją pierwszą prywatną sieć blogów Web 2.0 Budując świeżą sieć, powinieneś określić sobie ilość blogów, których użyjesz. Zazwyczaj zaczynam od 24 blogów i pozwalam im "leżakować" przez 2 tygodnie, by zobaczyć poważniejsze wyniki. Czasem potrzeba ich więcej, ale to już sprowadza się do Twojej analizy konkurencji. Używam dużej ilości Tumblr'ów, a to dlatego, że mogę ustawić ich dużą ilość w bardzo krótkim czasie. Powinieneś niedługo ujrzeć swoją stronę ze stabilnymi wynikami na drugiej stronie wyszukiwarki bez większych problemów. Pierwsza strona jest również możliwa, zależnie od konkurencji. Zacznijmy więc! Krok 1: znalezienie wygasłych blogów Ten krok sprowadza się głównie do tego jak dużo wolnego czasu chcesz na niego poświęcić. Za pierwszym razem po prostu je kupowałem, ale jak wiadomo, ma to pewne negatywne strony. Kupowanie wygasłych blogów zaoszczędzi sporo Twojego czasu - możesz zapłacić sprzedawcy nieco więcej, by wszystko za Ciebie załatwił, razem z wykupieniem domen itd. Negatywnym aspektem jest fakt, że nie masz kontroli nad tym jakie domeny dostaniesz. Nie zawsze sprzedawca wyśle Ci dobrej jakości domeny. Blogi kupować możesz np. na Fiverr lub SEOClerk. Niezbyt wielu sprzedawców sprzedaje Weebly lub Over-blog.com. Jednakże, jeśli poprosisz ich o nie, prawdopodobnie je dla Ciebie wyszukają. Harvestowanie wygasłych blogów Web 2.0 Jest to najlepszy sposób, jednak zajmuje sporo czasu. Jeśli go nie masz, kup blogi od kogoś sprawdzonego. Jednak zapewniam Cię, że nie znajdziesz nikogo, kto sprzedałby Ci chociażby taką perełkę: Czego będziesz potrzebował: Scrapebox Proxy Lista słów kluczowych Czas Używam Scrapeboxa, więc na jego przykładzie pokażę Ci jak wygląda proces wyszukiwania wygasłych blogów. Po prostu użyj domyślnych ustawień na sam początek, sprawdzają się bardzo dobrze. Ważne jest, byś używał prywatnych proxy, bez nich nie uzyskasz dobrych wyników. Wystarczy 10 sztuk (choć im więcej, tym lepiej). Załaduj je w zakładce Proxy klikając Load, następnie kliknij Use Proxies, zaznaczając to pole. Będziesz też musiał załadować trochę keywordów. Możesz znaleźć ogólnikowe słowa kluczowe online, wyszukanie ich w Google to łatwizna - możesz spróbować np. tej listy 100 tysięcy keywordów. Scrapebox ma też wbudowany wewnętrzny moduł scrape'owania keywordów, jeśli chcesz znaleźć odpowiednio stargetowaną listę. W lewym górnym rogu wpisujesz typ strony, której szukasz, np. szukając blogów Tumblr wpisujesz "site:tumblr.com". Następnie kliknij Start Harvesting. Gdy pojawi się harvester, po lewej wybierz silniki, których chcesz używać. Te, które zaznaczyłem na screenie sprawdzają się bardzo dobrze. Na dole sprawdź dodatkowo czy jest zaznaczona opcja User server proxies. Swoje prywatne proxy lepiej zachować do następnych akcji. Rozpocznij harvest. Mój trwa około 24 godzin i jest to wystarczająca ilość czasu, by zebrać pokaźną liczbę linków. Gdy harvest się zakończy, powinieneś mieć miliony URL'i, więc musimy je teraz nieco przefiltrować. Najpierw kliknij Trim, a z menu wybierz Trim To Root. Później kliknij Remove/Filter, a następnie Remove Duplicates. W górnym menu Scrapeboxa wejdź w Addons -> Show Available Addons. Zainstaluj Scrapebox Alive Check, a potem go otwórz. Gdy ukaże się okno Alive Checker, zaimportuj swoje linki w lewym dolnym rogu klikając Load urls. Zaznacz też opcję Use Proxies, ponieważ teraz będą nam przydatne nasze prywatne proxy, by wszystko przebiegało gładko. Ostatnią rzeczą do zrobienia jest kliknięcie Setup i wykasowanie całej zawartości nowo otwartego okna, a potem wpisanie jedynie 404. Kliknij OK, a następnie Start. Gdy proces się zakończy, kliknij Export i wybierz Save All Alive to Harvester. Powinieneś mieć teraz listę wygasłych web 2.0, których będziesz mógł użyć jako backlinki do swojej strony. Jest jednak jeszcze jeden krok, by znaleźć te najmocniejsze linki. Jest to sprawdzenie Page Rank. Mówi się, że Page Rank jest martwy, ale prawdą jest, że to nadal dobry sposób filtrowania stron. Im wyższy Page Rank, tym starsza strona, co zwiększa szanse znalezienia takich, które mają lepszy profil backlinków i większą moc. Kliknij Check Pagerank, a następnie Check URL Pagerank. Gdy już to zrobisz, kliknij Export URL List. Teraz Twoja lista wygląda już dużo lepiej, więc nadszedł czas, by posortować ją trochę i znaleźć wartościowe blogi. Bonusowa metoda wyszukiwania wygasłych Web 2.0 Nie tak dawno temu użytkownik @Moriarty napisał krótki poradnik o wyszukiwaniu wygasłych blogów/domen. W poradniku pokazuje on jak wyszukać je za pomocą programu DomainHunterGatherer. Polecam lekturę! Krok 2: nieoszlifowane diamenty Zanim przejdziemy dalej musisz wiedzieć, że nie każdy Tumblr będzie dostępny. Scrapebox szuka błędów 404, ale w większości przypadków Tumblr nie pozwoli Ci ich przejąć. Nie ma tak naprawdę sposobu na obejście tego problemu chyba, że napiszesz lub znajdziesz bota, który sprawdza prawdziwe błędy 404. Scrapebox jest dobry, jednak w tej kwestii jest nieco niedopracowany. Znajdź stronę, która sprawdza Page Authority (może być to np. Scrapebox z addonem Authority Checker + API MOZ z SeoTools). Możesz np. użyć 99Webtools - pozwalają na jednorazowe sprawdzenie 50 URLi. Będziesz też musiał zaopatrzyć się w kilka dodatkowych adresów e-mail, by rejestrować blogi. Sprawdź działy Sprzedam oraz Usługi na forum, by znaleźć zaufanych sprzedawców. Następny krok jest bardzo ważny! Przy każdej rejestracji konta używaj innego adresu IP. Możesz maksymalnie rozciągnąć to do zmiany IP co 3 konta. Jeśli użyjesz jednego IP do rejestracji dużej ilości Tumblr'ów, zostaną one po prostu zbanowane. Raz popełniłem ten błąd - z własnego lenistwa zarejestrowałem 10 Tumblr'ów z jednego adresu IP, a gdy po miesiącu chciałem coś na nich pozmieniać okazało się, że wszystkie zniknęły. Dobrą opcją jest użycie mobilnego internetu lub VPN. Gdy już ogarnąłeś problem z IP, otwórz Tumblr, a swoje linki miej w gotowości w narzędziu do sprawdzania authority. Jedyne co musisz teraz zrobić to skopiować nazwę użytkownika i zarejestrować się z jej użycie. Powtarzaj ten krok aż znajdziesz wolne konto. Krok 3: tworzenie backlinków web 2.0 Jest to chyba najłatwiejszy krok - dlatego osoby oferujące tworzenie backlinków uwielbiają Tumblr. Nie potrzebujesz super artykułow, a jedyne czego Ci potrzeba to zdjęcie i kilka linijek tekstu. Tumblr to platforma do zdjęć, więc po prostu dostosuj się do niej. Łatwizna, prawda? W ciągu kilku sekund utworzyłeś swój backlink web 2.0. Jasne, znalezienie stron zajmuje sporo czasu, ale jest to warte zachodu! Jeśli chcesz je zakupić, to nie widzę przeciwwskazań, ale po prostu będziesz potrzebował ich z czasem trochę więcej. Jedyne co robię na koncie to wrzucenie avatara i zmiana szablonu od czasu do czasu. Jeśli chodzi o Weebly lub Over-blog.com, będziesz musiał wrzucić artykuł - dlatego nie używam ich zbyt dużo na samym początku. Najpierw chcę zobaczyć jak zadziała sam Tumblr. Krok 4: współczynnik słów kluczowych Branding odgrywa ważną rolę w pozycjonowaniu, więc dobranie odpowiednich ilości słów kluczowych może mieć tu kluczowe znaczenie. Zdarzało się, że moje pozycje spadały poza TOP 300 w ciągu 24 godzin tylko dlatego, że użyłem swojego głównego keyworda o 1 raz za dużo. To, co zazwyczaj robię, to sortowanie swoich web 2.0 od najsłabszych do najsilniejszych. Te najsłabsze posłużą do naked URL (po prostu link do strony) oraz brandingu (nazwa strony, nazwa firmy), natomiast najsilniejsze nadają się idealnie do słów kluczowych. Dobrym narzędziem do znajdowania różnych słów kluczowych jest LSIGraph. W ten właśnie sposób robi się mocne blogi web 2.0. Nie jest to jednak koniec! Jest kilka rzeczy, o których warto wspomnieć. Co ostatnio zmieniło się na Tumblr i Weebly? Tak naprawdę - nic. Zmienili kilka rzeczy w ciągu ostatnich kilku miesięcy, alen ie miało to żadnych negatywnych skutków. W rzeczywistości, okazały się one ukrytym błogosławieństwem, ponieważ znalezienie dobrych blogów jest teraz jeszcze łatwiejsze. Zacznijmy od Weebly i ich "nie zaindeksujemy Twojego bloga". Nietrudno wyobrazić sobie jakim szokiem dla użytkowników była wiadomość, że ze względu na posiadanie darmowego konta, ich blog nie zostanie zaindeksowany w Google. W rzeczywistości jest to jedynie bardzo cwane posunięcie marketingowe popychające darmowych użytkowników do płacenia za konta. Cóż, my też możemy popchnąć Weebly! Wystarczy, że zmusimy Google do zaindeksowania bloga Weebly poprzez Google URL Submitter. Pozwoli nam to na obejście pliku robots.txt, a Google tak czy tak zaindeksuje bloga. Pokrętne przekierowania Tumblr'a Nie tak dawno temu duża ilość użytkowników stwierdziła, że Tumblr stał się bezużyteczny dla budujących linki, ponieważ zamiast linkować prosto do pozycjonowanej strony, Tumblr używa przekierowania typu: href=”http://t.umblr.com/redirect?z” + Twój URL Musiałem więc przetestować to samemu i sprawdzić czy moc dalej jest przekazywana, ponieważ Tumblr gra w tym poradniku pierwsze skrzypce. 2 tygodnie temu przeprowadziłem testy z 42 wygasłymi Tumblr'ami i oto wyniki: Była to świeża strona, więc te skoki były bardzo dobrym znakiem, szczególnie ten ostatni. Tydzień później pozycje podskoczyły jeszcze wyżej. Możesz z łatwością zauważyć, że ostatni keyword stoi na 16-tej pozycji przy konkurencji 41 - nie tak źle. Wniosek? Tumblr nadal przekazuje moc, a Weebly nadal jest indeksowane! Czemu ta metoda działa i przynosi efekty? Wszystko sprowadza się do wieku domen oraz do ilości naturalnych backlinków, które posiadają. W większości kampani SEO używane są web 2.0, nie bez powodu. Działają w praktycznie każdym przypadku - np. dywersyfikacja zaplecza lub podnoszenie pozycji. Różnica między nowymi web 2.0 a wygasłymi jest taka, że nowe są świeże i wymagają czasu, by nabrać mocy za sprawą dodatkowego linkowania, które musisz do nich wykonać. Użycie wygasłych blogów web 2.0, by osiągnąć stabilne pozycje na drugiej stronie Google, a następnie popychanie wyników wyżej jest moim zdaniem rozsądniejszym rozwiązaniem. Pamiętaj, Google KOCHA Authority. A teraz małe case study Strona nr 1 Jest to aktualnie moja ulubiona strona, która ma potencjał, by generować miesięcznie nawet pięciocyfrowe sumy. Strona, która znajduje się aktualnie na pierwszym miejscu na tej niszy generuje około $10,000 przychodu miesięcznie. Moja strona zajmuje aktualnie pozycje 2-4 miejsca poniżej. Jest to strona do generowania leadów dla produktu Clickbank - zbieram na niej adresy e-mail, a następnie puszczam kampanie marketingowe z promocją konkretnych produktów związanych z niszą. Długość treści na stronie to około 3700 słów. On-page SEO określam jako wręcz idealne, a więc jedyne czego było mi trzeba to dodanie backlinków. Jak widać na powyższym screenie, wszystkie słowa kluczowe są na pierwszej stronie, czyli tam, gdzie chcę. Nie obawiam się o pozycję nr 1 - strona i tak generuje niemały przychód, więc mogę odpocząć sobie chwilę zanim znowu przystąpię do pchania pozycji jeszcze wyżej za pomocą większej ilości linków. Pozycje mogą co jakiś czas minimalnie spadać, ale jest to całkowicie normalne przy tej metodzie. Google wyrzuci stronę wysoko, a potem pozwoli jej usadowić się na odpowiednich pozycjach, co jest dla mnie wyznacznikiem tego, że czas na drugą rundę linków. Strona wygenerowała już ponad 600 leadów, więc jest to gra warta świeczki! W chwili obecnej mam 2-3 sprzedaże dziennie, a przy dobrych wiatrach jest ich nawet 5 lub więcej, a nie jestem jeszcze nawet w Top 1. A więc jak udało mi się dojść tu, gdzie aktualnie jestem? Połączenie dobrego contentu i wygasłych web 2.0 posłało stronę niczym rakietę wprost na pozycje, na których jest teraz. Treści były wystarczająco dobre, by wyrzucić stronę od razu na pozycje 60-70, a użycie wygasłych blogów posłało ją jeszcze wyżej. Wspomnę jedynie, że konkurencja na tej niszy składa się m.in. z naprawdę dużych portali Na tej konkretnej stronie użyłem mixu Tumblr'ów i kilku blogów beep.com. Użyłem jednak tylko najlepszych Tumblr'ów jakie miałem ze względu na ogromną konkurencję. Większość blogów Tumblr, jakich użyłem miała naprawdę dobre backlinki, jak np. z Huffington Post. Większość anchorów w przypadku tej witryny to naked URL oraz branding. Zrobiłem tak, ponieważ większość stron w TOP 10 na tej niszy używała brandingu jako anchor-textów, więc uznałem, że warto się na tym wzorować. Ponieważ duża ilość stron z TOP 10 to duże serwisy, miały one mnóstwo naturalnych backlinków, więc musiałem sprawić, by moje backlinki również wyglądały naturalnie. Są jeszcze 2 inne strony innych marketerów, z którymi konkuruję i ich profil keywordów również zawiera praktycznie sam branding. Na tej stronie będę musiał utworzyć jeszcze dużo dobrej jakości blogów, jednak poczekam, aż pozycje jeszcze bardziej się ustabilizują, a w tym czasie będę pracował nad innymi stronami. Strona nr 2 Ta nisza ma już mniejszą konkurencję, ale wiąże się to też z tym, że generuje ona dużo mniejszy przychód, który oceniałbym na $1300-1600 miesięcznie przy wysokiej pozycji. Jest to również strona do generowania leadów dla oferty z Clickbanku, jednak dopiero co zacząłem ją rozkręcać. Jedyną różnicą jest to, że na tej stronie większość sprzedaży wyciągam z linków znajdujących się w treści strony, a nie z kampanii mailingowych. Jest to wskazówka, że w przypadku stron afiliacyjnych testy są bardzo ważne! Na tej witrynie użyłem też nieco mniej treści - nieco ponad 2300 słów. Konkurencja nie jest aż tak duża, a temat był dość trudny, więc nie było sensu "lać wody" i zatrzymałem się na 2300 słowach, by sprawdzić czy taka ilość wystarczy. Odpukać w niemalowane, wystarczyła Oto aktualne wyniki: Najlepsze jest to, że mogłem używać śmieciowych wygasłych web 2.0. Co to oznacza? Cóż, podczas harvestowania dziele moje wygasłe web 2.0 na dwa rodzaje: Dobrej jakości wygasłe web 2.0 Śmieciowe, słabej jakości wygasłe web 2.0 Używam więc dobrej jakości blogów dla nisz z dużą konkurencją, a wszystkie przeciętne lub słabszej jakości blogi zostają dla nisz z małą konkurencją. Jedyną różnicą jest jedynie użyta ich ilość. Choć używam śmieciowych, jak je nazywam, linków, nadal działają one bez zarzutu - po prostu potrzeba ich nieco więcej. Pamiętasz harvestowanie? Zazwyczaj harvestujemy dużo, więc warto zachować sobie te nieco gorsze blogi na zaś. Niektórzy mogą uznać to za stratę czasu, ale ja wolę zaufać swoim własnym testom i doświadczeniom. A więc czy jest to nadal dobry sposób pozycjonowania? TAK. Zazwyczaj bez problemu trafisz na pierwszą stronę wyników wyszukiwania z użyciem tych linków. Podsumowanie Jeśli chcesz szybkiego i prostego sposobu, by podskoczyć na pierwsze strony Google, właśnie go znalazłeś! Możesz tym sposobem budować naprawdę duże sieci blogów za pomocą tych web 2.0, a następnie używać ich do swoich nowych stron. Tylko od Ciebie zależy czy użyjesz tych blogów do jednej strony, czy do kilku! Osobiście używam jednego bloga web 2.0 do 2-4 stron, by nie mieć zbyt dużej ilości linków wychodzących. Pamiętaj, że nie musisz ograniczać się jedynie do web 2.0. Jest to po prostu jeden z moich sposobów na pozyskiwanie linków. Jest wiele footprintów, których możesz użyć do tworzenia swojej prywatnej sieci blogów! Pamiętaj też, że dużą liczbę narzędzi do pozycjonowania znajdziesz w naszym forumowym SeoTools - są tam setki płatnych serwisów i programów w cenie jedynie 79.99zł! Nie znajdziesz nigdzie lepszej oferty! Poradnik przetłumaczony za pieniądze z forumowych reklam.- 128 odpowiedzi

-

- 40

-

-

-

Cześć Szukam dostawcy w Polsce który ma serwery dedykowane z windows 10, możecie kogoś polecić ? Czy na tych stronach są weryfikację ? Jeśli tak to w jaki sposób ona wygląda ? Na tych serwerach będą działania blackhatowe.

- 1 odpowiedź

-

- serwer

- serwer dedykowany

-

(i 3 więcej)

Oznaczone tagami:

-

Witam, zaczynam zabawę z SEO i zastanawiam się czy warto próbować rozruszać stronkę przez kopiowanie tekstów z innego języka, tłumaczenie ich w DeepL, wrzucenie w jakiś spinner, potem grammaly? Działał bym z tym równolegle do innego projektu

- 4 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Jakim softem się aktualnie wspieracie w swoich strategiach pozycjonowania? W szczególności zastanawiam się czy jest obecnie jakiś działający soft, który sprawdza się przy budowaniu tier 1. Jeszcze kilka lat temu było sporo różnych narzędzi tego rodzaju, a teraz mam wrażenie że większość z nich jest martwa.

- 2 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Spis treści: [Część 1] Czym jest linkbuilding - definicja, czemu linkbuilding jest ważny [Część 2] Typy linków - czyli linkbuilding robiony w odpowiedni sposób [Część 3] Kampania linkbuildingowa - z czym to się je [Część 4] Linkbuilding - taktyki budowania linków [Część 5] Jak ocenić czy backlink jest dobrej jakości [Część 6] Dobry, zły i brzydki linkbuildingu - czyli whitehat vs blackhat [Część 7] Linkbuildingowe triki, które każdy powinien znać Często można się spotkać z rozmowami na temat "whitehat" lub "blackhat" SEO (rzadziej można też trafić na dyskusje dot. greyhat, który dotyczy przestrzeni pomiędzy whitehatem a blackhatem). Zazwyczaj rozmowy te dotyczą linkbuildingu. Ta część serii poradników pomoże Ci zrozumieć różnice między tymi technikami oraz poznać zalety i wady obu z nich. Linkowanie Whitehat Strategia whitehat to taka, która niesie za sobą jak najniższe ryzyko i zazwyczaj współgra z wytycznymi Google/Bing dot. linkowania stron. Używanie technik whitehatowych oznacza więc, że masz bardzo małe szanse na jakiekolwiek nieprzyjemności ze strony wyszukiwarek internetowych w kwestii ruchu ograniczonego banem/filtrem. Oto kilka przykładów whitehatowego linkbuildingu: Tworzenie własnego, ciekawego i dobrego jakościowo contentu Tworzenie zaangażowanej społeczności, która wchodzi w interakcję z Twoją stroną Promocja strony wśród odpowiednio stargetowanej grupy osób w sposób szczery i etyczny, np. przez pisanie spersonalizowanych maili Zalety takiego podejścia to m.in. to, że nie musimy martwić się o auaomatyczne lub manualne działania ze strony wyszukiwarek (bany/filtry). Whitehat działa świetnie w przypadku prawdziwych użytkowników i pozwala na zbudowanie długotrwałych i silnych wyników, które nie znikną z dnia na dzień. Wady - musimy stale skupiać się na dość mocno oddalonym od nas celu zamiast na szybkich korzyściach. Strategia whitehat ma to do siebie, że wymaga czasu, by pokazać swoje zalety i zwiększyć Twój zasięg. Linkowanie Blackhat Dawniej słowo bloackhat było używane do określenia hackerów komputerowych, choć aktualnie najczęściej korzystamy z niego do określenia technik, które mają na celu obejść wytyczne wyszukiwarek. Ich celem jest odnalezienie luk w algorytmach i wybicie stron na pozycje wyższe, niż te uznane wcześniej przez w/w algorytmy. Kilka przykładów: Cloacking - pokazywanie wyszukiwarce innych treści niż te, które widzą prawdziwy użytkownicy Umieszczanie ukrytych linków na stronach, do których nie posiadasz uprawnień Ukrywanie na stronie tekstów pokazywanych tylko wyszukiwarkom, najczęściej tekstów pełnych słów kluczowych, na które chcemy się wybić Taktyki te rzadko działają na dłuższą metę, ponieważ algorytmy są stale aktualizowane w celu pozbycia się osób korzystających z blackhatu. Oznacza to, że ruch oraz pozycje mogą spaść drastycznie nawet w ciągu jednego dnia. Czemu whitehat jest tak ważny Powiedzmy, że budujesz biznes online i chcesz, by ten biznes utrzymywał się na rynku przez długie lata. Jeśli chcesz to zrobić, musisz ostrożnie dobierać taktyki oraz stale oceniać ryzyko, które za nimi idzie. Na przykład, firma offline'owa może spróbować jakiegoś "triku" PRowego, którego celem będzie zwiększenie rozpoznawalności marki. Nieodłącznym ryzykiem jest wtedy możliwość, że trik ten nie wyjdzie, co negatywnie wpłynie na markę oraz odstraszy potencjalnych klientów. Jako firma musisz znaleźć równowagę pomiędzy zyskami a potencjalnymi stratami każdej aktywności marketingowej. Dlatego właśnie techniki whitehat są tak ważne - niosą za sobą najmniejsze ryzyko i jest bardzo mało prawdopodobne, byś został ukarany przez Google. Skupiają się one na dodawaniu prawdziwych i wartościowych treści do internetu. Jeśli chcesz zbudować bazę lojalnych klientów, która nie tylko chętnie od Ciebie kupuje, ale również chętnie poleca Cię innym, musisz dostarczać im ciekawych i wartościowych informacji. To, co działa dziś może nie działać jutro - gdzie wtedy zostaniesz? Wielu blackhatowców zamieni jedną blackhatową technikę na drugą i koło się zamknie. Problem jednak jest taki, że dla większości firm jest to niedopuszczalna sytuacja. Jeśli więc porównamy to z technikami whitehatowymi, to pewnie zauważysz, że działasz w celu uzyskania długotrwałego efektu. I choć jedne działania mogą nieść za sobą lepsze rezultaty niż inne, to nie musisz stale oglądać się za siebie i obawiać się kolejnych aktualizacji algorytmu Google. Słów kilka o kupowaniu linków Linkbuilding to często ciężkie zajęcie. Szczególnie we wczesnym stadium naszej kariery, kiedy nadal staramy się zbudować sobie reputację, znaleźc odpowiednich ludzi do współpracy i tworzyć dobre jakościowo treści. Nie jest więc trudno zrozumieć, że pozycjonerzy szukają czasem drogi na skróty. W tym akapicie skupimy się na kupowaniu linków. Na wstępie warto zaznaczyć, że kupowanie linków jest wbrew zasadom Google! Wyszukiwarkom przeszkadzają kupowane linki, ponieważ zaburza to organiczne wyniki wyszukiwania. Oficjalnym celem jest stworzenie algorytmu, dzięki któremu strony będą wysoko w wynikach, ponieważ na to zasługują, a nie dlatego, że mają duż pieniędzy na kupowanie backlinków. Zauważ również, że w wytycznych wspomniane są linki do manipulowania PageRank'iem - oto różnica pomiędzy kupionym backlinkiem a kupioną reklamą Kupowanie reklam, które linkują do Twojej strony jest w porządku i może być to świetny sposób na zbudowanie sobie renomy. Jednakże warto wtedy zadbać o to, by reklama nie przekazywała PR do Twojej strony. Jest na to kilka sposobów: Dodanie atrybutu nofollow Dodanie JavaScript w linku, by Google nie mogło przez niego przejść Stworzenie przekierowania w robots.txt Te techniki sprawią, że reklama nie wpłynie na Twój PageRank, czyli nie będzie to miało żadnego wpływu na Twoje pozycje. Ogólnie rzecz biorąc, kupowanie linków to ryzykowna sprawa i jest to rzecz nieopłacalna dla większości firm. Krótkoterminowe zyski są często przewyższane przez zyski długoterminowe i jeśli tworzysz prawdziwą markę oraz chcesz korzystac z organicznych wyników Google do zdobycia klientów, to kupowanie linków może być ryzykowne. Blackhat SEO, filtry i bany Jeśli zostaniesz przyłapany na łamaniu zasad Google, to prawdopodobnie zostaniesz za to ukarany. W zależności od przewinienia, karą może być utrata pozycji na kilka tygodni lub miesięcy. Może też być to kara, która zostanie zdjęta dopiero po tym, jak naprawisz istniejący problem. W internecie można znaleźć kilka przykładów dużych firm, które zostały ukarane przez Google za łamanie ich wytycznych. JC Penney - duża firma z USA została mocno ukarana w Lutym 2011 za kupowanie dużej ilości linków targetujących konkretne keywordy. Dopiero po kilku miesiącach strona zaczęła odbijać się od dna, a pracownicy musięli poświęcić mnóstwo czasu na usunięcie linków. Innym przykładem, który miał miejsce kilka tygodni później jest Overstock, który został ukarany za dawanie zniżek uniwersytetom w zamian za linki. W tym przypadku strona również została ukarana na kilka miesięcy. Znanym przypadkiem w UK jest sytuacja z 2013 roku, kiedy to kwiaciarnia Interflora została ukarana na 11 dni. Google nie skomentowało całej sytuacji, ale większość twierdzi, że sprawa dotyczyła linków. Wszystkie te przykłady trafiły na nagłówki, ponieważ ukarane firmy były duże i rozpoznawalne. W rzeczywistości jednak, Google rozdaje te kary praktycznie codziennie. Są różne rodzaje takich kar: Działania ręczne W tym przypadku pracownik zespołu Google nakłada na stronę karę osobiście po znalezieniu naruszeń regulaminu. Może być to cokolwiek, od kupowania linków, przez złe przekierowania aż do cloakingu. Aby pozbyć się tej kary należy wysłać prośbę o ponowne rozpatrzenie uwzględniając w niej: Co zrobiliśmy, by naprawić problem Jak planujemy uniknąć tych sytuacji w przyszłości Jasny dowód na oba powyższe Wtedy pracownik ponownie rozpatrzy Twoją prośbę i zadecyduje czy zdjąć karę. Czasem może być tak, że zgłosi się on do Ciebie ponownie z twierdzeniem, że zrobiłeś za mało i że nadal musisz popracować nad problemem. Dobrym przykładem jest sytuacja, gdy zostałeś ukarany za kiepskiej jakości linki i nie usunąłeś ich wystarczającej ilości. Ręczne działania są zawsze widoczne w Google Search Console. Filtr algorytmiczny Google potrafi automatycznie znaleźć problem z Twoją stroną i automatycznie zaaplikować odpowiednią karę. Jest to zazwyczaj spowodowane jakimś problemem na stronie, np. cloakingiem lub ukrytymi linkami. Musisz więc naprawić problem, by pozbyć się filtra. Nie musisz wysyłać zgłoszeń, ponieważ kara może zostać zdjęta przy następnym crawlowaniu strony przez robota Google. Niestety, czasem jednak filtr trzyma się jak rzep psiego ogona i mimo wszystko musimy wysłać prośbę o rozpatrzenie. Jeśli nie wiesz jak pozbyć się bana lub filtra, to pomoże Ci w tym ten poradnik dot. Ahrefs: Czemu zwykła wymiana linków to zły pomysł W dawnych czasach wymiana linkami z innymi stronami WWW była świetnym sposobem na pozyskiwanie backlinków. Sposób ten był jednak mocno nadużywany - pozycjonerzy zamiast wymieniać się linkami z dobrymi jakościowo stronami, wymieniali się dosłownie z kim popadnie. Doprowadziło to do sytuacji, gdzie niektóre witryny miały specjalne podstrony do wymiany linków. Witryna taka miała więc na takiej podstronie linki do setek lub nawet tysięcy innych witryn niezwiązanych w żaden sposób z jej własną tematyką. Z tego powodu Google walczy z praktyką wymiany linków. Gdy mowa o linkbuildingu, Google chce, by linki był zdobywane uczciwie. Mają one być wyznacznikiem jakości strony, a nie towarem. Dlatego wyszukiwarka ta nie ma problemu ze stronami linkującymi do siebie, ale muszą mieć one ku temu powód (czyt. dobrej jakości treści). Normalnym więc będzie, gdy np. news na BBC zostanie zacytowany w CNN, a kilka tygodni później CNN zacytuje BBC. Jest to technicznie wymiana linków, ale czy uważasz, że Google ukaże za to obie te strony? Nie, ponieważ mają one powody, by do siebie linkować i robią to w sposób naturalny dla dobra swoich użytkowników. A teraz postaw to sobie obok strony, która posiada na jednej z podstron tysiące nagich linków, wszysktich kierujących do tysięcy stron niezwiązanych ze sobą w żaden sposób. Wtedy łatwiej Ci będzie zauwazyć róznicę między dobrą a złą wymianą linków Pamiętaj, że wszelką optymalizację swoich backlinków najlepiej wykonywać z wykorzystaniem odpowiednich narzędzi. Narzędzia te jednak często sporo kosztują. Dlatego polecamy Ci sprawdzenie naszej oferty SeoTools, gdzie znajdziesz mnóstwo serwisów dla profesjonalistów za zaledwie ułamek ceny!

- 7 odpowiedzi

-

- 9

-

-

- linkowanie whitehat

- blackhat seo

- (i 6 więcej)

-

dobra, chłopaki, może ja wejdę wam w dyskusję, a czym indeksujecie podstrony na pbnach czy też nowych domenach? próbuje różnych metod, niestety, np: pbn-y - wszystko powyżej site 10-15 (przy zakupie), wrzucam nową stronę - artów na każdego bloga około 50 lub max 50 - zero zaindeksowanych podstron. Nowe blogi - to samo, albo mi główną zaindeksuje po kilkunastu dniach i tylko główną (czyste, nic na nich wcześniej nie było), albo dzisiaj jest 2 podstrony, za kilka godzin - nie ma nic w indeksie itd. Myślałem że rok temu był problem z indeksowaniem, ale teraz to katastrofa, bo wtedy jak już arty zaczęły wchodzić to już wchodziły, a teraz null.

- 5 odpowiedzi

-

https://www.blackhatworld.com/seo/anyone-site-only-4-results-indexed-penalty-now.1318746/ Niezależnie od branży (choć w afiliacji częściej) coraz częsty problem, a kara sprytnie zrobiona, w GSC zero powiadomień, jedyne co to spada widoczność strony i ucina site Urle niby są w indeksie ale mają praktycznie zerową widoczność w serpach. Domena która dostaje site 4 nie ma kompletnie mocy jako docelowa, ani jako zaplecze. Pisałem już o tym od lutego zeszłego roku, Google w ten sposób flaguje strony docelowe (np. w afiliacji) oraz zaplecza w różnej postaci. I nie tylko strony na cloakingu dostają tą karę, strony z napisanym contentem przez copy też? Może po prostu za tematyke supli. Udało się komuś wyjść z tej kary site 4 ?

- 26 odpowiedzi

-

- 1

-

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Hejka nazywam się Jakub i od dłuższego czasu chciałem postawić bloga, z niszą na cheaty z racji względnie dostępności zainteresowanych. Na dniach postanowiłem że w końcu zrobię cokolwiek bardziej opartego na własnej str www tak więc bloga ładnie zrobiłem[tak mi się wydaje] wczoraj skończyłem go i wleciał pierwszy post, plan na dziś to 2 i od jutra 3 posty dziennie, niedawno wysłałem prośbę o zaindeksowanie w googlach i aktualnie liczę na jak najszybszy "dostęp" Plan miałem w głowie ułożony mniej więcej jak działać z linkami, pingowanie strony, tworzenie powoli zaplecza typu funpage i insta ale nie miałem pomysłu jak prowadzić je długo terminowo i tu się zaczął problem. dziś w pewnym momencie poranka dostałem amnezji dosłownie😴 i nie wiem za co się zabrać po kolei i chciałbym zorganizować sobie dzienny plan w którym chciałbym poświęcać 2-4h dziennie na działania aby widzieć efekty. Tak na teraz wygląda to tak co o tym sądzicie ? Pisać posty, dziennie 3 optymalnie przez AI z podanymi głównymi key wordami które sam następnie redaguję i sprawdzam jak w WP przez Yoast SEO wygląda ich jakość oraz w content analysis [inna apka] długość tekstu +- 2.5k znaków. stronami do indexowania pingować domenę - ma to sens? zagraniczne na zagranicznych forach mega różne opinie są. nauka linkowania [black,white] - brzmi głupio ale i wiem i nie wiem jak to robić w darmowy sposób, budżet na ten miesiąc mój to +- 40zł więc jedyne co moge to kupić jakieś 5 linków z fivera pewnie. tu by mi na pewno pomogło posiadanie funpage jak i instagrama co w tym 2 dosyć dobrze się poruszam tylko jedyny problem od buta weryfikację dostaje po założeniu konta na różne ip na różnych urządzeniach nie znam bypassa na to. optymalizacja zdjęć i tagów czeka przede mną dziś na pewno. Myślę też często o jakiejś niszy w której nie wyczerpią mi się za szybko pomysły do tematów np krypto mam jeden fajny pomysł który ma ciekawy ruch na socialach z bardzo małym zaangażowaniem w google [z tego co szukałem] tylko muszę upewnić się o jej legalność chociaż na pierwszy i drugi rzut oka wygląda w porządku oraz czy mógłbym połączyć w jednego bloga pod to. W teorii tak w praktyce chyba średnio będzie to wygodne dla wyszukiwarki. Jeśli macie jakieś pomysły piszcie śmiało wszystko biorę pod uwagę, idę czytać dzienniki pracy może znajdę odpowiedzi kierunku 😁 A jeśli nie masz pomysłu to możesz napisać jak wyglądały twoje początki z tworzeniem

- 4 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Witam czy jak na aktualny stan 2023, są jakieś działające programy pozycjonujące ?

- 2 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Witam. Zastanawia mnie, jak to jest, że wchodząc przez reklamę google w stronę przykładowo xyz.com, pokazuje się inna treść "docelowa", niż jak potem samemu wpisuje ręcznie ten sam adres? Zastanawia mnie, co to za rodzaj cloackingu... Jedyny jaki znam, to pokazywanie google "safe page", a klientów przekierowywuje na landing page. Nie rozumiem, jak to działa, że ten sam adres pokazuje 2 różne strony, w zależności czy wchodzi się przez reklamę google, czy normalnie bezpośrednio... Najczęsciej są to stażowe zagraniczne strony z końcówką .com. Byłbym bardzo wdzięczny jakby ktoś byłby skłonny mi to wytłumaczyć :)

- 5 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 3 więcej)

Oznaczone tagami:

-

Cześć, szukam jakiejś altenatywy dla Serposcope. Znacie coś innego darmowego do postawienia na swoim serwerze? Ostatnio serposcope sie popsuł i google go wycina dlatego szukam alternatywy. Z góry dzięki za odpowiedź

- 1 odpowiedź

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

.thumb.png.eb2eca800d2ccce8016cf2e0c30e8934.png)

Generator zdań posiadających podaną frazę - generator tekstu

prawilniaczek opublikował(a) temat w Black Hat

Hej. Szukam czegoś prostego - generatora losowych zdań, w którym będzie podane przeze mnie słowo lub cała fraza. Zdania mogą nie mieć sensu, choć jak będą miały to będzie super. Byle nie było to drogie, najlepiej darmowe jak się da. Taki prosty generator tekstu. Chciałbym, żeby działało po polsku i po angielsku. Za każdy link lub podpowiedź odwdzięczę się reputem. Elo!- 6 odpowiedzi

-

- 1

-

-

- black hat

- pozycjonowanie

-

(i 5 więcej)

Oznaczone tagami:

-

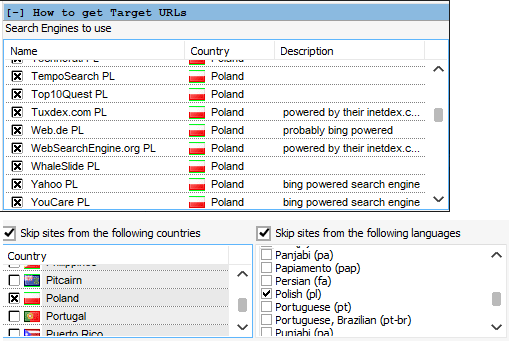

Dzień dobry. Czy można ustawienia dać takie aby np promocja była tylko w jednym kraju. bo np mam stronę polską i nie potrzeba mi promocji w Japonii... Dałem ustawienia jak na zdjęciu a backlinki dalej są z każdej lokalizacji. Czy ustawienia są złe, czy w innym miejscu trzeba to zmienić czy jakoś to inaczej wygląda? Z góry dziękuję za pomoc

- 2 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Poszukuję jak najtańszego serwisu, który oferuje proxy na GB. I można nimi bez problemu scrapować wyniki z Google. Nie interesują mnie oferty powyżej 4$ za 1 GB.

-

Cześć wszystkim, Czy znajdzie się tu ktoś kto ma jakiś dostęp do platformy CXL? https://cxl.com/ Ponad 800 stówek chcą za miesiąc...

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

jak działa refund service? czy to jest legit? i na co uważać?

- 11 odpowiedzi

-

- 1

-

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Witajcie. Czy ma wpływ linkowanie z adresów IP np FR do pozycjonowania właśnie pod ten kraj? Czy to bez znaczenia czy to będzie hosting z ip np PL, FR, DE czy inny

- 2 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Czy zna ktoś jakiś program darmowy/płatny do monitoringu ilości zaindeksowanych stron czyli site:domena.com w google (czyli np. wrzucam 1000 stron i pokazuje jaka każda z nich ma site)? Myślałem, że może scrapebox ma jakąś wtyczkę, którą w sposób wygodny można byłoby sprawdzić, ale niestety chyba nie. Kiedyś był darmowy Google Site SEO Master, ale widze, że sobie na radzi z tym zadaniem.

- 5 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami:

-

Witam, dopiero zaczynam z pozycjonowaniem i trochę już poczytałem o tym na forum i z tego względu mam kilka pytań (może podstawowych) dotyczących SEO Widziałem że jest dużo wtyczek na wp dotyczących SEO, osobiście korzystam przez jakiś czas z Yoast Seo jednak na forum dużo zaawansowanych użytkowników pisze o tym że im mniej wtyczek tym lepiej. Na Yoast Seo (w wersji darmowej) są jakieś limity dotyczące słów kluczowych itd oczywiście po to aby wykupić konto premium. Jednak widziałem że są metody na ręczne dodawanie słów kluczowych (tamten poradnik tyczył się głównie słów kluczowych w header.php) Kod do wpisania: <meta name=”keywords” content=”your keywords here” /> Pewnie też jest jakiś sposób na ręczne dodawanie słów kluczowych do artykułów bloga - i pewnie kod jest ten sam. I dużym plusem takiego ręcznego dodawania (tak mi się wydaje) jest to że w przypadku zmiany wtyczki dot. seo (gdy wszystko dodajemy we wtyczce) - opisy meta i słowa kluczowe zostaną utracone (?) Dlatego chciałem się zapytać jak wy dodajecie różne słowa kluczowe do waszej strony i wpisów na blogów - czy przez jakiś plugin? czy ręcznie? Oraz czy jest sens kupować jakąś wtyczkę pod SEO w wersji premium? - czy to nie ma większego znaczenia Dodatkowo pewnie podstawowe pytanie ale nie znalazłem jakiejś konkretnej odpowiedzi, z Tego co widziałem to teoretycznie chyba nie ma limitu słów kluczowych. Jednak wydaje mi się że jeśli ktoś wstawia zbyt dużą ilość słów kluczowych pod artykułem to google może uznać to za spam i z pozycjonowania tworzy się odwrotny efekt - dlatego zastanawiam się czy wstawianie np max 200 słów kluczowych w artykułach i umieszczenie większej ilości na stronie głównej np 1000 jest dobrym pomysłem?

- 3 odpowiedzi

-

- black hat

- pozycjonowanie

-

(i 1 więcej)

Oznaczone tagami: